喂饭式教程 - 腾讯云HAI服务原生安装Ollama部署DeepSeek

一、什么是Ollama

Ollama是一个专注于在本地机器上便捷部署和运行大型语言模型(LLM)的开源框架。

简单的说,就是DeepSeek是运行在Ollama软件中的,要使用DeepSeek需要先安装Ollama。

二、开通HAI服务

进入腾讯云高性能应用服务 HAI 的购买页面,选择应用->基础环境,选择对应的操作系统,选择合适的配置,开通后就可以使用 HAI 实例。

此处有 Linux Ubuntu 版本及 Windows Server 版本,后续将分别对两种操作安装Ollama进行介绍。

三、Linux 部署 Ollama

3.1、复制安装命令

打开 Ollama 官网,点击下载,选择 Linux ,复制安装命令。

3.2 命令安装 Ollama

在服务器终端输入命令,等待下载安装。

curl -fsSL https://ollama.com/install.sh | sh

3.3、安装DeepSeek模型

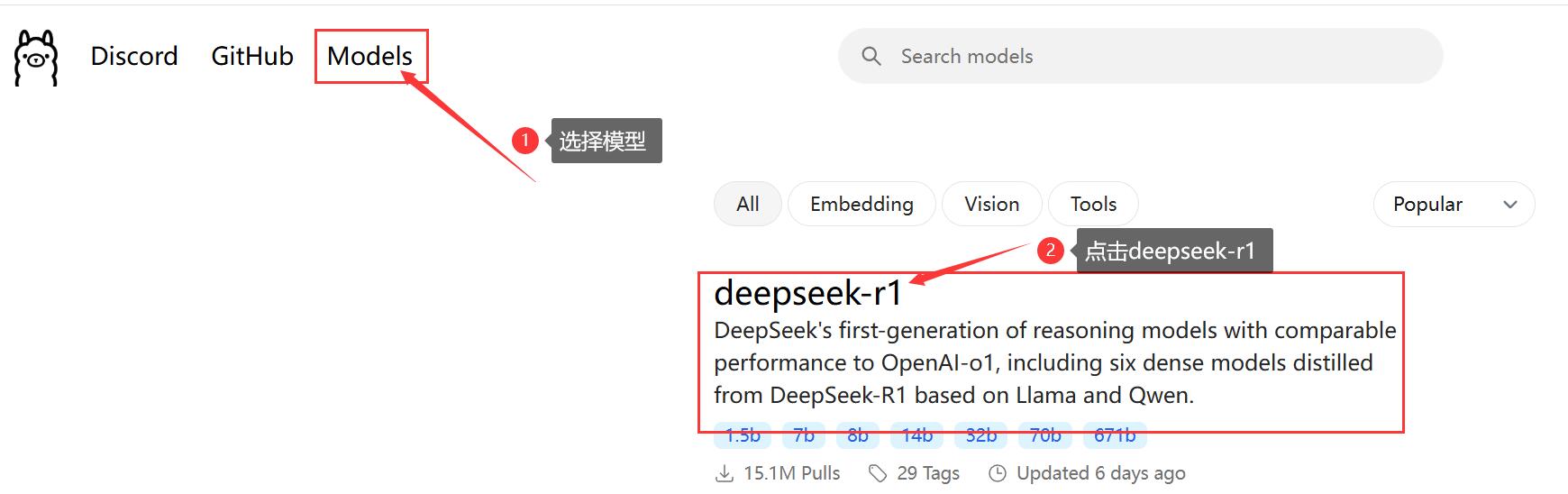

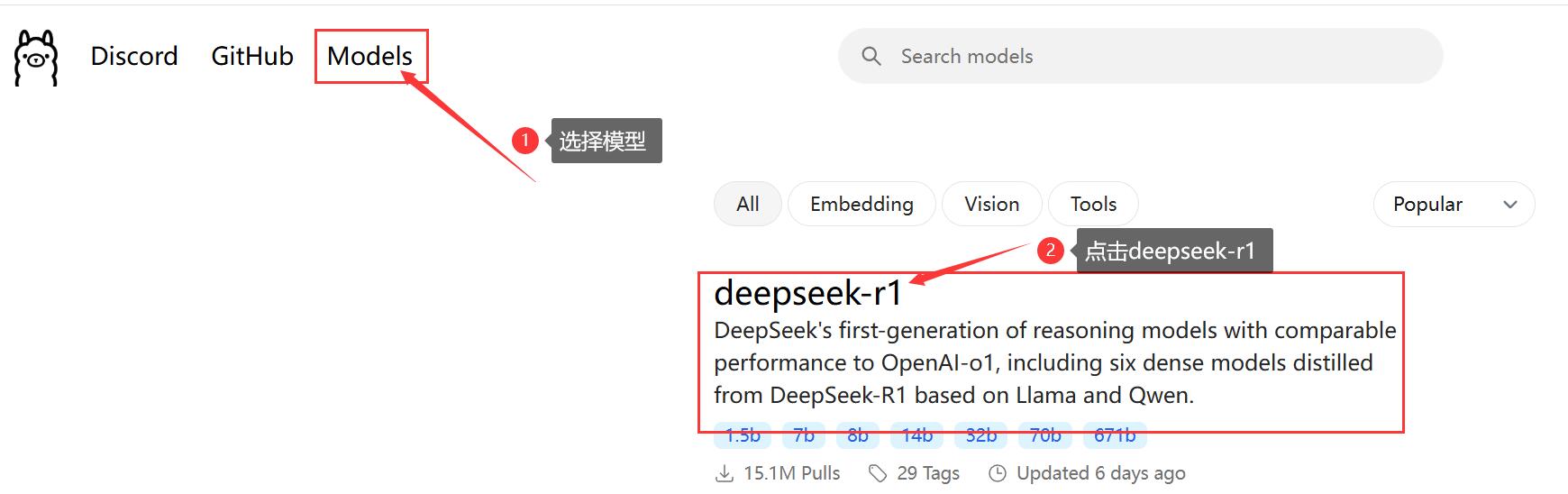

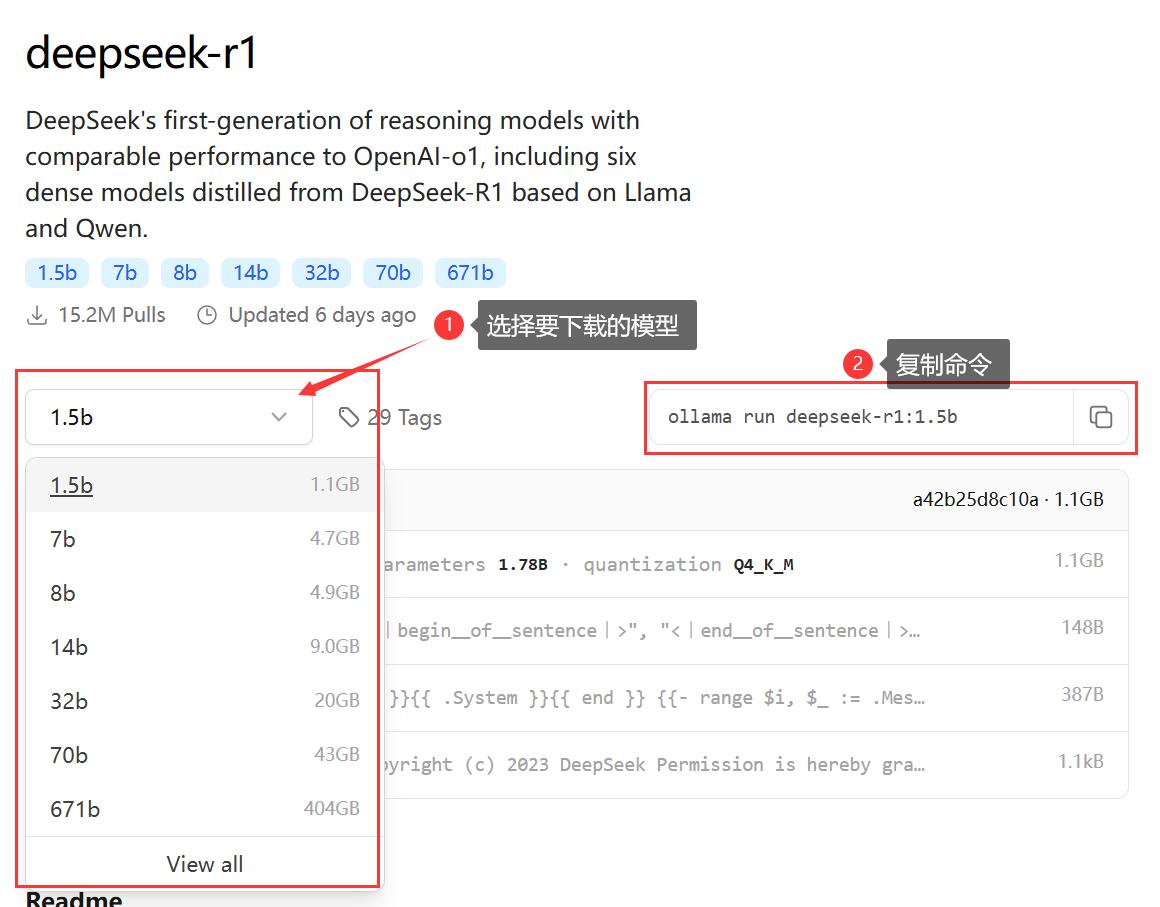

在官网点击Models栏目,选择deepseek-r1,选择对应的模型,复制模型安装命令。

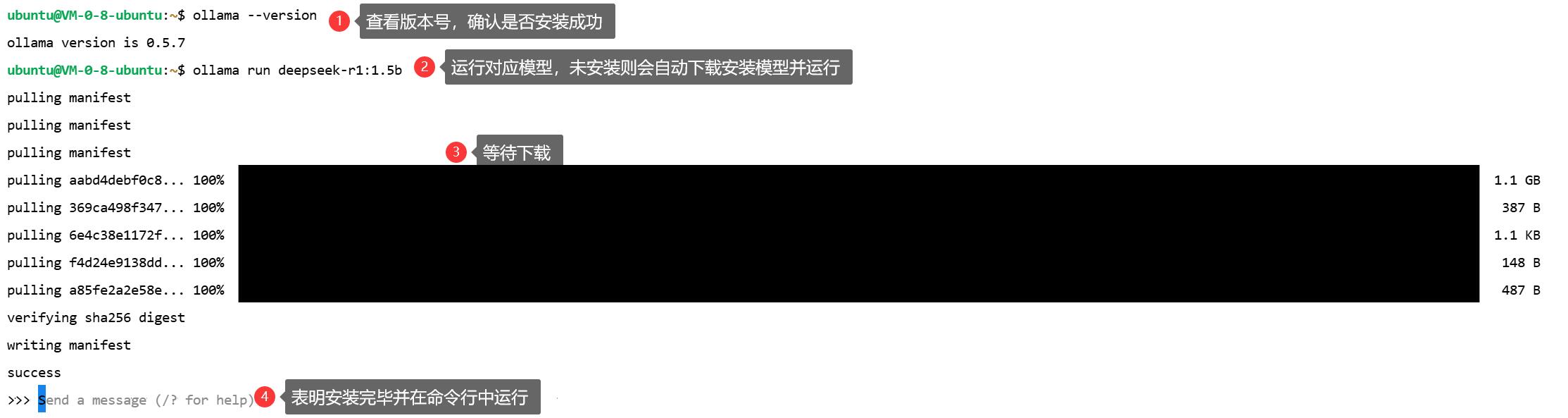

3.4、在终端运行命令安装模型

输入Ollama版本号命令查看是否安装成功,然后输入模型安装命令

# 查看Ollama版本号

ollama --version# 安装模型

ollama run deepseek-r1:1.5b

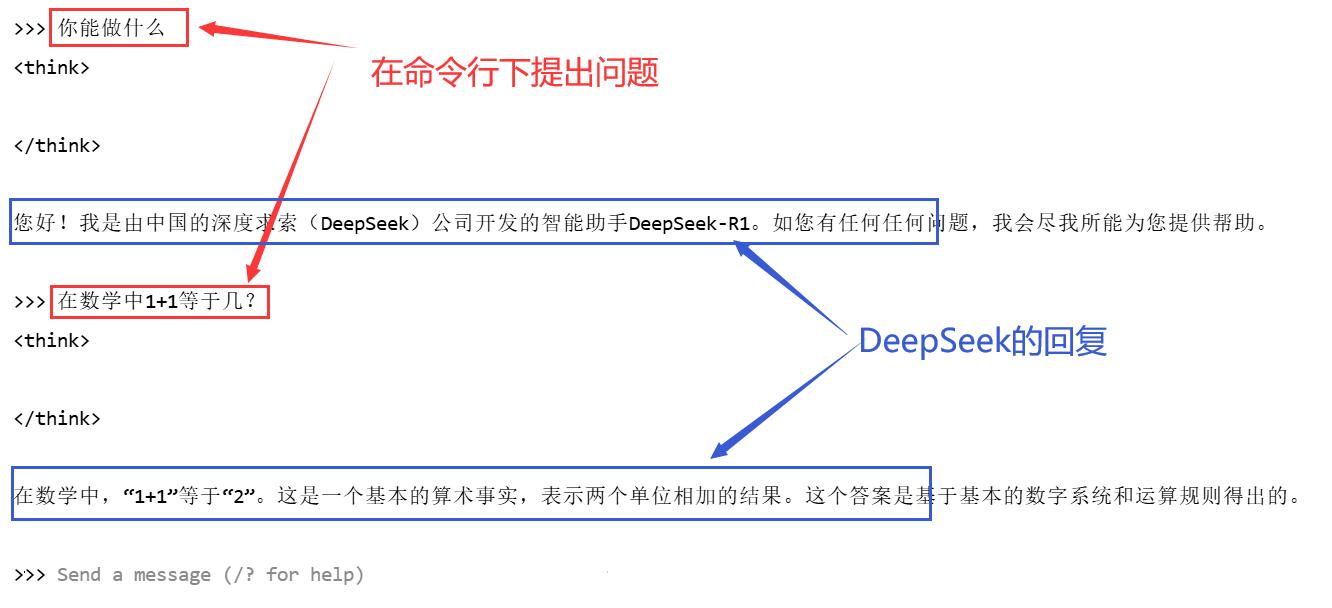

3.5、进行对话

可以直接在命令行进行对话,DeepSeek模型将会直接回复。

四、Windows 部署 Ollama

4.1、下载Ollama安装软件

打开 Ollama 官网,点击下载,选择 Windows ,下载软件安装程序,完成安装。

4.2、选择DeepSeek模型

在官网点击Models栏目,选择deepseek-r1,选择对应的模型,复制模型安装命令。

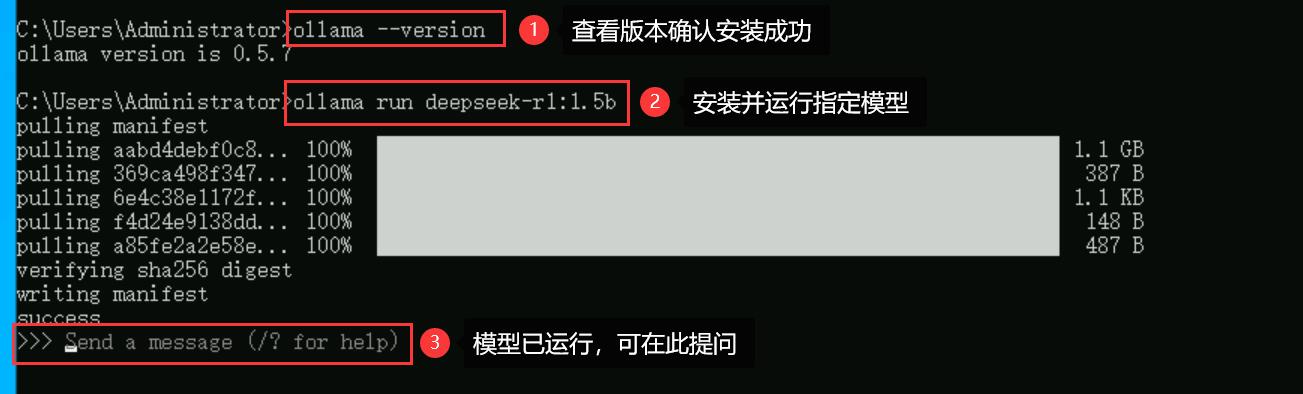

4.3、运行命令安装模型

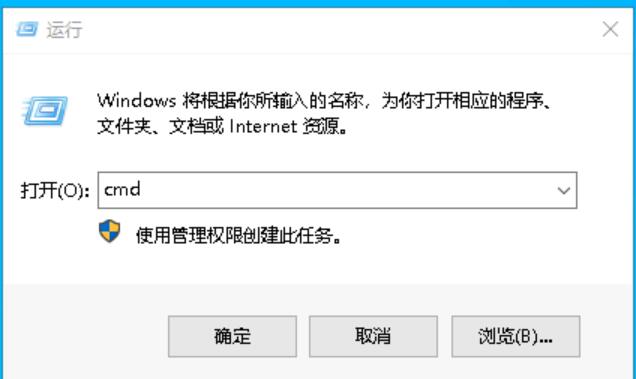

Windows系统左下角 鼠标右键开始菜单,选择运行,输入cmd。

在打开命令窗口上,输入以下命令,完成安装

# 查看Ollama版本号

ollama --version# 安装模型

ollama run deepseek-r1:1.5b

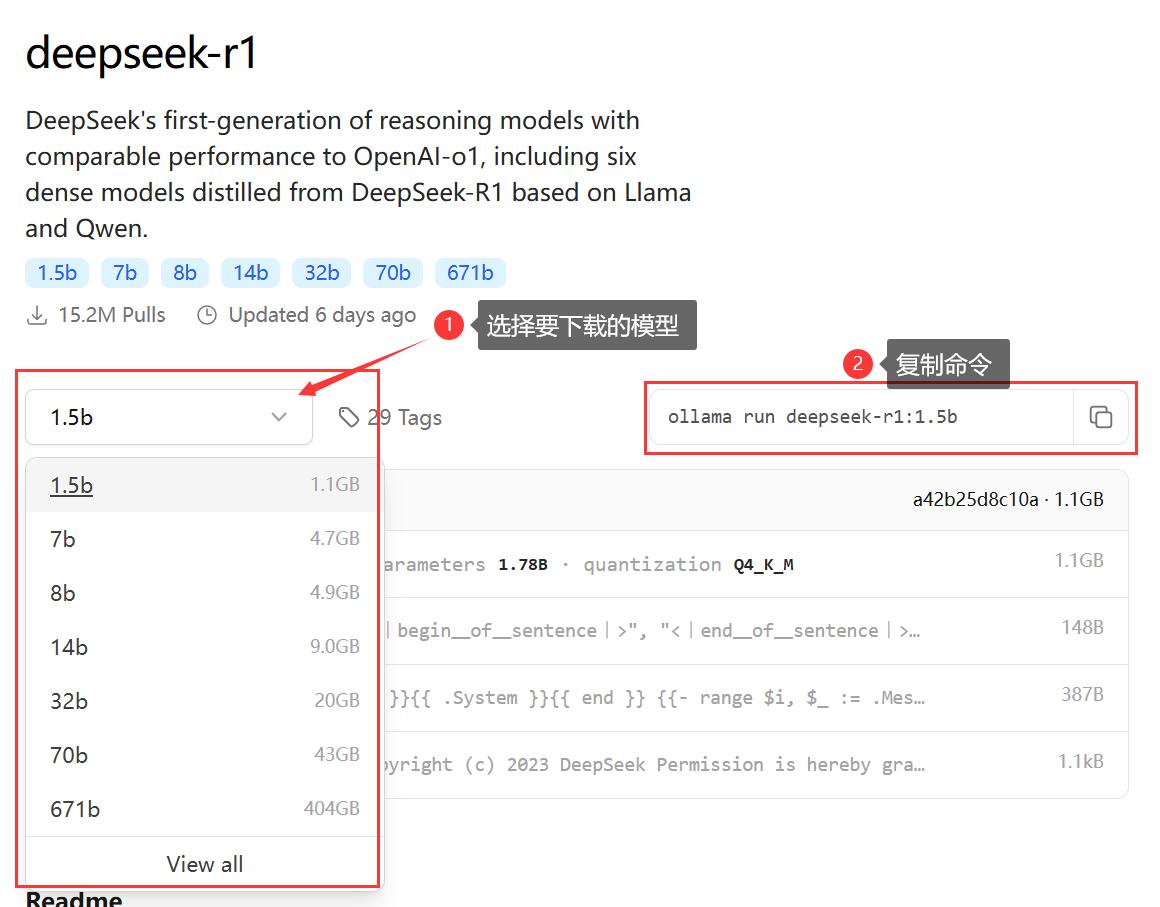

五、选择什么样的模型

DeepSeek-R1就是深度搜索-R1模型,包含Distilled models 的是蒸馏模型。

| 模型 | 模型名 | 模型大小 |

|---|---|---|

| DeepSeek-R1-Distill-Qwen-1.5B | deepseek-r1:1.5b | 1.1G |

| DeepSeek-R1-Distill-Qwen-7B | deepseek-r1:7b | 4.7G |

| DeepSeek-R1-Distill-Llama-8B | deepseek-r1:8b | 4.9G |

| DeepSeek-R1-Distill-Qwen-14B | deepseek-r1:14b | 9.0G |

| DeepSeek-R1-Distill-Qwen-32B | deepseek-r1:32b | 20G |

| DeepSeek-R1-Distill-Llama-70B | deepseek-r1:70b | 43G |

| DeepSeek-R1 | deepseek-r1:671b | 404G |

通常所说的“满血版R1”指的是deepseek-r1:671b,该模型对硬件要求很高,相当的费用也会比较高,通常也可以选择蒸馏模型。

从表中可以看出,模型参数越大则文件体积越大,相应的对硬件要求也就越高。从运行结果来看,拥有更大参数量的模型(如DeepSeek-R1)在推理效果上更胜一筹,但另一方面,更小参数的 Distilled models(蒸馏模型)模型的响应速度更快、占用资源更少、部署时长更短,在处理较为简单的任务时,仍是不错的选择。

具体选择要根据服务硬件参数来决定,配置低的就选择低参数量,如要追求更好的推理结果,高参数量的模型也必须搭配高配置的服务。

如果运行一个模型响应很卡顿,大概率说明服务配置不够,可以考虑升级配置或降低模型参数量。

版权声明:本文为原创文章,版权归 本站 所有,未经许可,不得转载。

本文地址:https://www.yiisu.vip/hai_ollama_deepseek.html

如对本文有疑问可在评论区留言,博主会尽力解答,同时欢迎关注微信公众号“云计算课代表”。