大模型知识引擎打造企业专属AI智能客服

通用大语言模型与知识引擎的应用区别

通用大语言模型具有很多功能,用于AI智能客服应用中,可以对公开知识库进行回答,但对于细分行业,或具体企业的特有知识库,通用大模型则无法做到精确回答。

比如:电信行业中某企业用于解决用户的宽带配置、上网调试、故障报修等场景的知识库,由于企业自身特殊的硬件设备及特有的配置方法,使用通用大模型做为AI客服,因为没有此类数据,往往无法准确的回复用户的咨询,进而导致人工客服工作量的增加。

而大模型知识引擎则更加注重对特定领域的专业知识进行详细、精确地整理,通过人工手动构建或者利用自动化技术整理,可以提高信息准确性。

本文将介绍如何通过腾讯云大模型知识引擎LKE,完成企业特有知识库,搭建AI智能客服。

什么是腾讯云大模型知识引擎LKE

大模型知识引擎(LLM Knowledge Engine),是面向企业客户及合作伙伴的,基于大语言模型的知识应用构建平台,结合企业专属数据,提供知识问答等应用范式,更快更高效地完成大模型应用的构建,推动大语言模型在企业服务场景的应用落地。

模拟特定问答的测试

假设现在有2个问题,为该企业日常咨询量最高的问题,正确的问答内容如下:

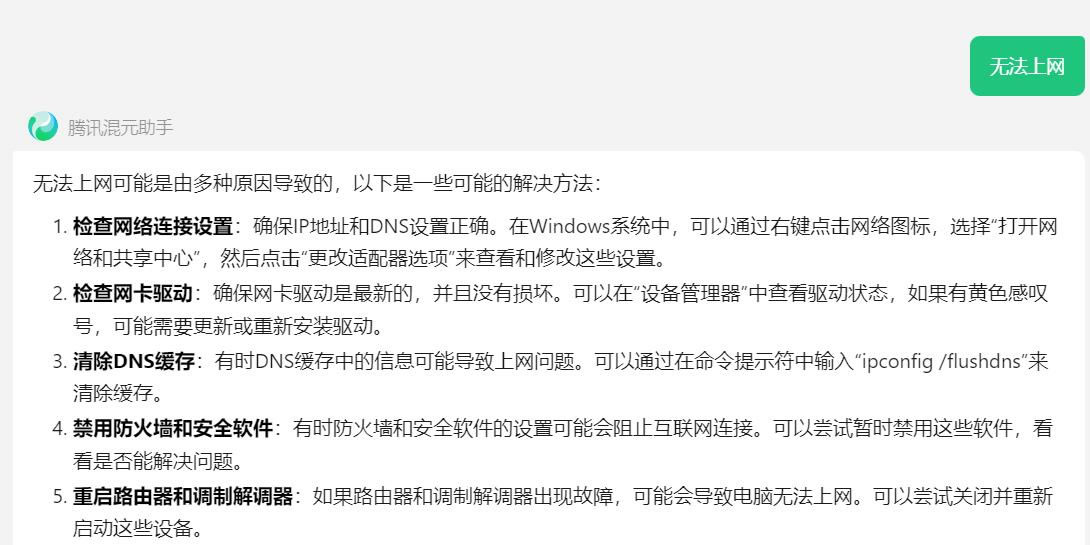

问题1:无法上网

答案1:查看设备第2个指示灯(标为Lan),如亮红灯则需重启设备,如绿灯闪烁则表示宽带欠费。

问题2:如何重启设备

答案2:按下开关键关闭电源,等待5秒后,再按下开关键启动设备,待绿灯全部常亮表示设备启动完成。

在此场景下,如果企业接入的是通用大语言模式,得到的答案虽然也较为正确,但可能无法满足用户需求,如下所示:

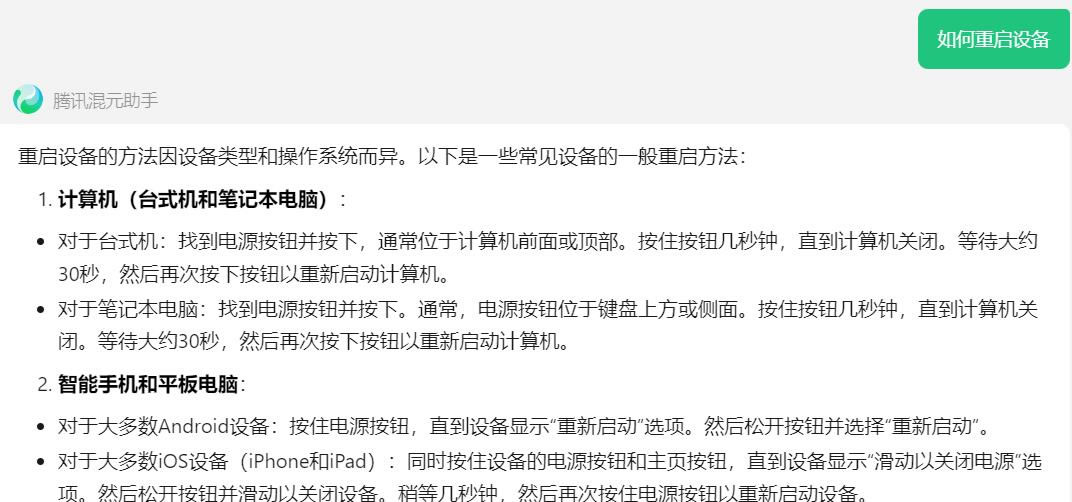

当使用了腾讯云大模型知识引擎LKE后,通过配置,则可以正确的实现问答,如图所示:

腾讯云大模型知识引擎LKE也同样具备AI问答的基本特点,支持自然语言的沟通。如上述问题提问变成:无法上网怎么办、不能上网了、如何重启设备、设备怎么重启等表述,同样也能给出正确的答案。

通过更多、更完善的问答数据的配置,可以实现问题的快速精确回答,以下介绍如何进行知识引擎的配置。

大模型知识引擎配置步骤

一、新建应用

1、进入大模型知识引擎 LKE控制台,点击新建应用。

大模型知识引擎 LKE:https://cloud.tencent.com/product/lke

2、输入名称,建立应用。

二、配置应用

1、应用配置

在应用配置界面,大多参数保持默认即可直接使用,也可以设置应用名称、角色、欢迎语、模型等。

如设置欢迎语,则会在客户侧显示其内容。

2、知识库管理

知识库管理是对知识库中的 文档、 问答、任务流程、 知识标签 等内容进行管理的功能。将知识导入系统后,设定的应用将形成基于有关知识的业务知识库,可直接根据知识库中的内容对用户问题进行解答。

有多种导入方式,如图所示:

3、内容录入

以问答为例,可手工录入问题,也可以导入问答。

3.1、手工录入,按上图所示,进入手工录入。

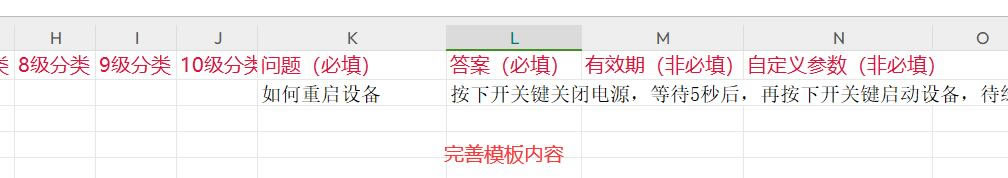

3.2、导入问答,下载模板后,完善模板内容,然后上传即可。

4、发布管理

导入的文档、问答等,默认无法使用,此时点击右上角发布按钮,进行发布。

三、测试知识引擎

找到创建的应用,点击“调用”,在打开的页面中,进入体验链接进行测试。

接入业务系统

除了直接使用体验链接进行体验外,也可以通过API的方式,开发程序接入自有业务系统,官网文档有详细说明。

知识库问答应用接口文档(WebSocket)https://cloud.tencent.com/document/product/1759/105560

知识库问答应用接口文档(HTTP SSE)https://cloud.tencent.com/document/product/1759/105561

总结

通过使用腾讯云大模型知识引擎LKE,可以实现企业自有知识库,搭建人工AI客服,提高回复内容的准确性。

版权声明:本文为原创文章,版权归 本站 所有,未经许可,不得转载。

本文地址:https://www.yiisu.vip/ai_lke.html

如对本文有疑问可在评论区留言,博主会尽力解答,同时欢迎关注微信公众号“云计算课代表”。